编者按:欢迎阅读“科研上新”栏目!“科研上新”汇聚了微软亚洲研究院最新的创新成果与科研动态。在这里,你可以快速浏览研究院的亮点资讯,保持对前沿领域的敏锐嗅觉,同时也能找到先进实用的开源工具。

4月23日至4月27日,深度学习与表征学习领域最负盛名的学术会议之一的ICLR,将在巴西里约热内卢举行。我们通过两期“科研上新”为大家带来多篇微软亚洲研究院入选ICLR 2026的精选论文解读。在第一期中,我们分享了强化学习基础理论分析、长上下文推理和代码生成验证的专项优化、智能体探索能力的优化等研究工作。 (opens in new tab)第二期我们将聚焦多模态生成、视觉与音频生成、具身智能机器人操作、神经网络内核优化等方向,呈现从大模型能力创新到机器人落地应用、再到底层性能优化的完整技术链路,展现从理论突破到工程实践的前沿探索。

本期内容速览

1.AdAEM:一种自适应且自动扩展的大语言模型价值观差异度量方法(Oral)

2.Aurelius:面向大规模的关系感知文本转音频生成

3.BAR:重构自回归视觉生成的基础

4.基于上下文学习的高效大语言模型微调数据选择

5.TileLang:一款面向GPU深度学习算子实现的特定领域编程语言(Oral)

6.TwinVLA:利用孪生单臂VLA模型,实现数据高效的双手操作

7.VidGuard-R1:基于推理多模态大语言模型与强化学习的AI生成视频检测与解释

8.villa-X:增强VLA模型中的潜在动作建模

9.VisCodex:通过融合视觉与编码模型,实现统一的多模态代码生成

1.AdAEM:一种自适应且自动扩展的大语言模型价值观差异度量方法(Oral)

论文链接:https://openreview.net/forum?id=qNlTH4kYJZ (opens in new tab)

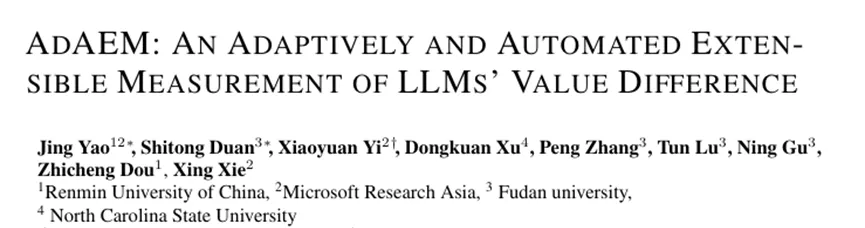

在大语言模型的价值观评估中,现有测试数据集常面临“信息量不足”的挑战。由于测试问题陈旧、存在数据污染或过于通用,这些测试往往只能捕捉模型在安全合规等通用价值观上的趋同倾向,难以揭示不同模型间细微且具有区分度的价值观取向差异。

为解决这一问题,研究员们提出了自适应、自动化可扩展的测量框架AdAEM。该方法突破了静态数据集的限制,利用来自不同文化和时期的多个大语言模型,探测其内部的价值观边界,并基于信息论目标函数自动生成和扩展评测问题,旨在挖掘具有争议性和区分度的主题,从而最大化模型间的价值观分歧。

实验表明,利用AdAEM构建的测试数据集(AdAEM Bench)包含12310个问题,在语义多样性和新颖性上显著优于现有数据集。通过Value Priming实验验证,该框架不仅能有效缓解数据污染问题,还能精准捕捉模型在特定议题下的价值偏移,展现出极高的构念效度与信度。

在对比评估中,AdAEM成功揭示了GPT-4、Claude、Llama及GLM等不同架构和地域来源的模型在施瓦茨十大价值观维度上的差异,而这些差异在其他测试集中往往是扁平或混淆的。此外,AdAEM具备良好的扩展性,能够通过整合最新发布的模型自动生成反映当下社会热点的评估问题,为跨学科的大模型价值对齐与风险诊断提供了可靠工具。

2.Aurelius:面向大规模的关系感知文本转音频生成

论文链接:https://openreview.net/forum?id=LAYCYiIgZ1 (opens in new tab)

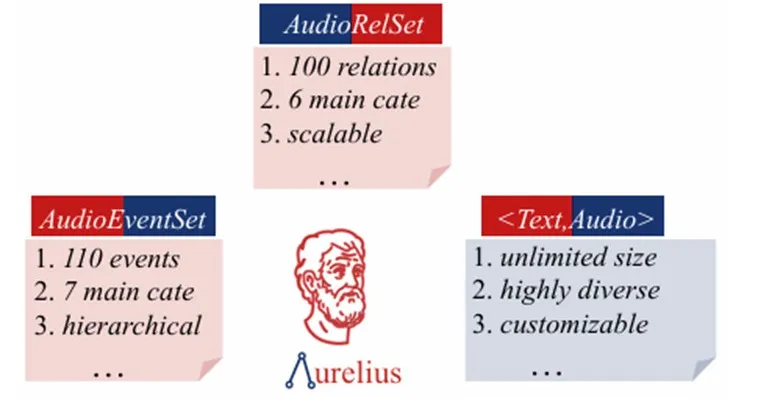

文本到音频(TTA)生成技术在通用音频合成上已取得显著进展,但现有模型在处理涉及多事件组合、时空关系及逻辑约束的“关系感知”生成任务时表现不佳,难以像人类一样理解文本中的复杂关系并生成对应的声学场景。

为此,研究员们提出了Aurelius框架,构建了包含110个类别的高质量音频事件语料库AudioEventSet,以及涵盖100种关系的AudioRelSet,系统性地覆盖了物理世界与文本描述中的潜在关系。结合创新的“文本-音频对”生成策略,该框架能够创建海量训练数据,并配套多维度评估协议。

实验表明,现有主流TTA模型在关系感知任务上的各项指标均低于10%,即使引入智能体工作流分解任务亦收效甚微。通过在构建的数据集上进行微调或从头训练,模型的关系建模能力显著提升。Aurelius提供的大规模基准测试与数据资源,为推动关系感知TTA从单事件生成迈向结构化、关系化的音频合成奠定了基础。

3.BAR:重构自回归视觉生成的基础

论文链接:https://openreview.net/forum?id=2m9XQq4Dc3 (opens in new tab)

尽管自回归(AR)视觉生成模型在图像合成领域取得了进展,但在处理图像token时通常依赖固定的光栅扫描顺序,难以充分捕捉图像固有的二维结构,限制了模型性能。而现有的改进方法多基于人工设计的归纳偏置,缺乏统一的数学框架,导致不同设计之间难以比较且易陷入局部最优。

研究员们提出了基自回归(Basis Autoregressive, BAR)新范式,将图像视为向量空间中的点,通过线性变换矩阵A重构基向量,从而自适应地学习最优的token预测顺序。该框架统一了VAR、xAR、RAR、PAR等主流AR变体,并以端到端优化目标(含残差损失)替代手工先验,配合正交投影约束保证变换稳定性。

实验表明,BAR在ImageNet 256×256基准上取得FID=1.15,创下自回归模型SOTA。BAR-H(1.1B参数量)在轻量条件下超越同等甚至更大规模的扩散模型与掩码生成模型。同时,BAR在文本到图像生成任务上也表现出色,证明了该框架能有效克服人类先验偏差,大大提升图像生成的收敛速度与质量。

4.基于上下文学习的高效大语言模型微调数据选择

论文链接:https://openreview.net/forum?id=Cw9Bxpda2h (opens in new tab)

在大语言模型的微调过程中,训练数据普遍存在的噪声与低质量样本会稀释监督信号,严重影响模型与人类偏好的对齐效果。尽管精选的小规模数据集往往能达到与大规模数据相当的性能,但如何在不依赖昂贵的重复训练或复杂的启发式规则的前提下,系统且高效地识别高价值数据,仍是当前领域的挑战。

为此,研究员们提出了一种基于上下文近似(ICA)的高效数据选择与重加权框架,利用上下文学习机制,通过将留出集(holdout set)作为提示词注入模型,动态估计加入候选样本后的留出损失变化,从而量化每个样本的价值,且无需额外训练参考模型或反复微调。在此基础上,研究员们还设计了基于ICA分数的梯度重加权策略,在模型训练过程中动态调整不同样本的权重,使模型优先学习最能有效降低留出损失的高质量样本。

实验显示,该方法在监督微调(SFT)、直接偏好优化(DPO)及SimPO等多种对齐范式中均表现优异。在Alpaca、UltraFeedback等多个基准数据集上,ICA重加权训练的模型在GPT-4o评估的胜率指标上持续超越标准训练与RHO-Loss、One-Shot等基线方法,且计算开销极低,仅需约1.5%的额外运行时间。

消融实验进一步证实,通过k近邻筛选少量留出样本作为上下文示例即可达到最优效果,动态权重可显著提升模型在领域适配与高质量数据上的对齐精度,为大模型微调中的高效数据筛选提供了轻量化、高实用价值的解决方案。

5.TileLang:一款面向GPU深度学习算子实现的特定领域编程语言(Oral)

论文链接:https://openreview.net/forum?id=Jb1WkNSfUB (opens in new tab)

现代 AI 模型广泛采用融合内核(fused kernels)来提升计算效率,但现有编译框架在内存层级管理、数据布局和并行调度方面的控制粒度有限,开发者往往面临手写 CUDA 的高开发成本与高级抽象的性能折损之间的两难。

针对这一问题,TileLang 提出了一套可编程的 tile-level 抽象原语,支持开发者显式控制内存放置、数据搬运和并行调度策略。系统的核心技术 Layout Inference 将 tile 程序建模为融合图,通过部分标注自动推导完整的 tile 配置与数据布局约束,在保留底层控制力的同时显著降低内核开发复杂度。

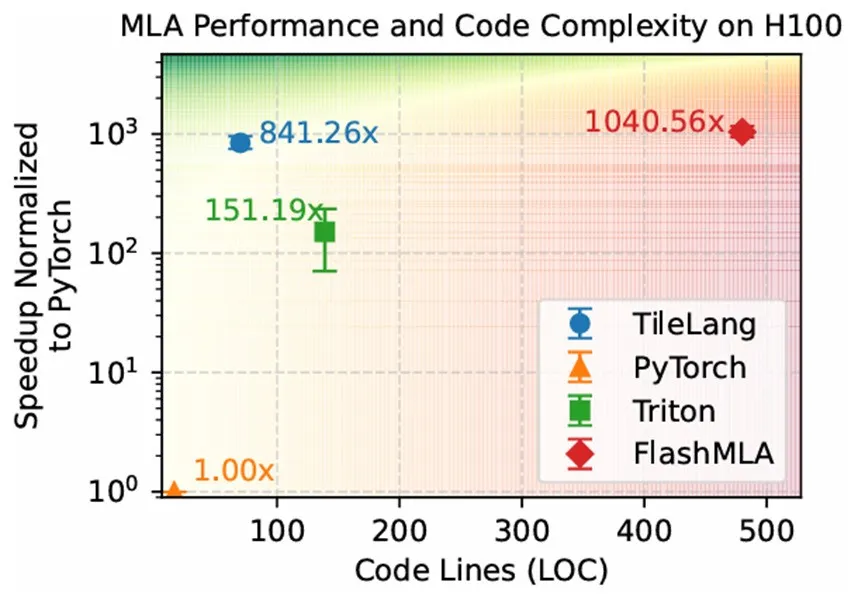

实验结果表明,TileLang 在 H100 上最高实现对TritonLang约 5 倍加速,在 AMD GPU 上最高约 6 倍加速;各类融合 Attention 内核仅需约 80 行 Python 代码即可实现,较手写实现代码量大幅缩减。在 MLA 场景下,TileLang 达到了手工优化的 FlashMLA 库约 98% 的性能。论文进一步表明,基于tile 粒度的性能建模与自动推断机制能够有效指导 tile 配置与优化搜索,从而在可编程性和性能之间取得更好的平衡。

6.TwinVLA:利用孪生单臂VLA模型,实现数据高效的双手操作

论文链接:https://openreview.net/forum?id=jG9W6nAwVz (opens in new tab)

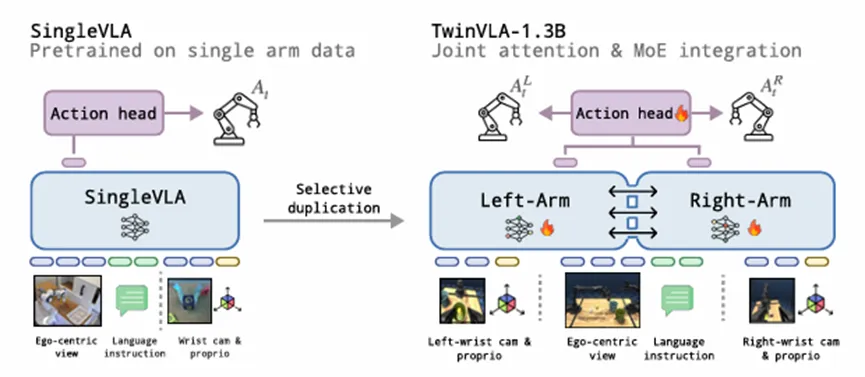

由于动作空间高维耦合及公开双手机器人数据集稀缺,双手机器人操作的传统方法常依赖大规模专有数据收集与昂贵算力,严重制约了视觉-语言-动作(VLA)模型在该领域的泛化与复现。

对此,研究员们设计了模块化框架TwinVLA,其核心在于复用并协调两个预训练的单臂VLA(SingleVLA)。该方法通过联合注意力机制与混合专家(MoE)层连接孪生模型,在保留各自预训练能力的同时实现双臂协同,避免了从头训练大规模双手机器人数据的需求。

实验结果表明,TwinVLA在真实世界长程任务及RoboTwin、Tabletop-Sim等仿真基准上均表现出色。尽管仅使用约800个单臂任务演示与少量双臂微调样本,但其1.3B参数版本在多项任务上超越同等规模的RDT-1B模型,并在多项任务中逼近依赖海量专有数据的3.3B参数模型π₀。消融实验证实,联合注意力与注意力重加权机制在促进跨臂信息交换及维持预训练知识方面的关键作用,证实了基于模型组合的模块化架构是实现数据高效且高性能双手机器人操作的有效路径。

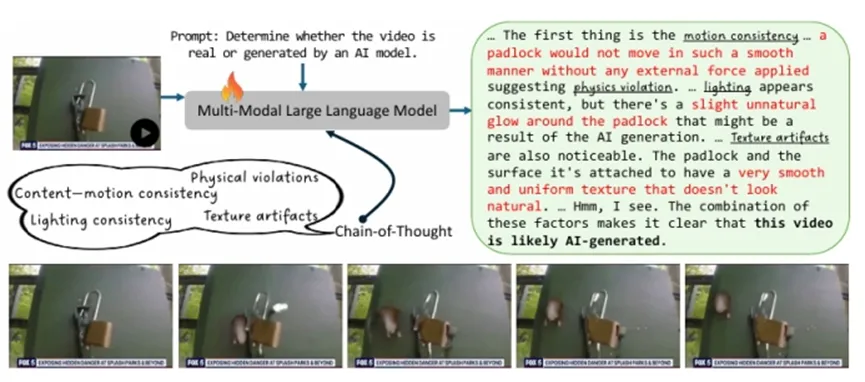

7.VidGuard-R1:基于推理多模态大语言模型与强化学习的AI生成视频检测与解释

论文链接:https://openreview.net/forum?id=gXjOsBcXIR (opens in new tab)

随着AI视频生成技术飞速进步,高度逼真的合成视频带来虚假信息、隐私侵权等社会风险。现有检测方法多依赖静态数据集进行监督微调或直接偏好优化,难以捕捉现代生成模型的多步物理不一致性,且通常仅输出无解释的二元判断,无法满足内容审核与法律追责的透明度需求。

为此,研究员们提出了 VidGuard-R1,这是首个基于多模态大语言模型,采用 GRPO 强化学习的视频真伪检测框架。该方法通过强化学习激励模型探索多条推理路径,并设计了面向时序一致性与扩散复杂度的专用奖励模型,引导模型发现基于物理规律的伪造痕迹。同时,研究员们还构建了包含14万条高质量样本(7万真实来源视频,7万同场景下的AI视频)的高难度评测数据集。

实验表明,VidGuard-R1在自建数据集上准确率达85%,在GenVidBench与GenVideo两大权威基准上准确率均突破95%,显著超越现有主流检测模型与多模态大语言模型基线。同时,模型可输出精准、可验证的推理依据,在人工评估中取得最高解释质量评分,有效打破了传统检测方法的“黑盒”局限。

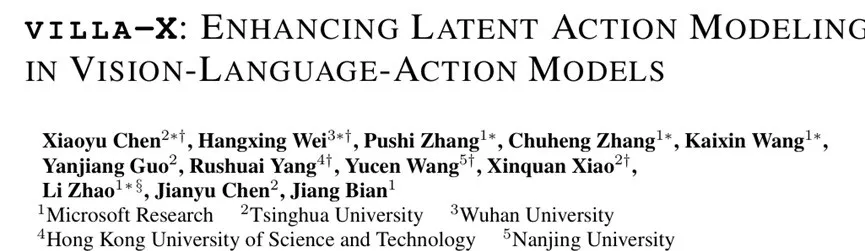

8.villa-X:增强VLA模型中的潜在动作建模

论文链接:https://openreview.net/forum?id=y5CaJb17Fn (opens in new tab)

潜在动作(latent action)为人类和机器人创造了一套统一的动作表征空间,使得利用海量互联网数据进行机器人控制策略的预训练成为可能。然而,现有的潜在动作建模方法通常仅依赖视觉信号,导致学到的潜在动作空间与真实的物理控制空间无法对齐(lack of grounding),也未能有效将潜在动作中的信息融入VLA模型的预训练中。这种建模方式往往会过度放大视觉上显著的动作(如大范围移动),却难以捕捉视觉上不明显但对底层控制至关重要的物理动态(如末端执行器的旋转与夹爪的开合)。

为解决这一痛点,实现潜在动作与物理控制空间的有效对齐(grounding),研究员们提出了 villa-X 框架。该框架创新性地引入了本体感觉前向动力学模型(Proprio-FDM),使得潜在动作在捕捉视觉变化的同时,能够更敏锐地感知与控制相关的物理状态,大幅增强了潜在动作的物理对齐性。此外,研究员们还设计了一套视觉-语言-潜在动作模型(Vision-Language-Latent action-Model),通过联合学习潜在动作序列与机器人底层控制序列,实现了结构化的高效信息传递。

实验结果表明,villa-X 在潜在动作规划上展现出卓越的泛化能力。面对未见过的机械臂本体和开放域(open-concept)目标,villa-X 可以依靠潜在动作生成合理的规划来完成任务。在 SIMPLER 等主流仿真器上,villa-X 成功超越了 pi-0、GR00T 和 LAPA 等一系列前沿方法,实现了性能的显著提升。同时,在真实物理环境中,仅需少量数据微调,villa-X 即可在 Realman 机械臂和 Xhand 灵巧手上顺利完成各项任务。其中,尽管预训练阶段仅使用了常规机械臂数据,但villa-X 仍能依靠微调泛化至灵巧手控制任务中,展现了其潜在动作训练框架的强大泛化潜力。

基于物理对齐的潜在动作学习与联合扩散机制是 villa-X 的核心创新。其内置的潜在动作专家网络(Latent Action Expert)有效桥接了高层视觉语言指令与底层物理控制,为构建可扩展的通用机器人操作策略提供了一种全新的范式。

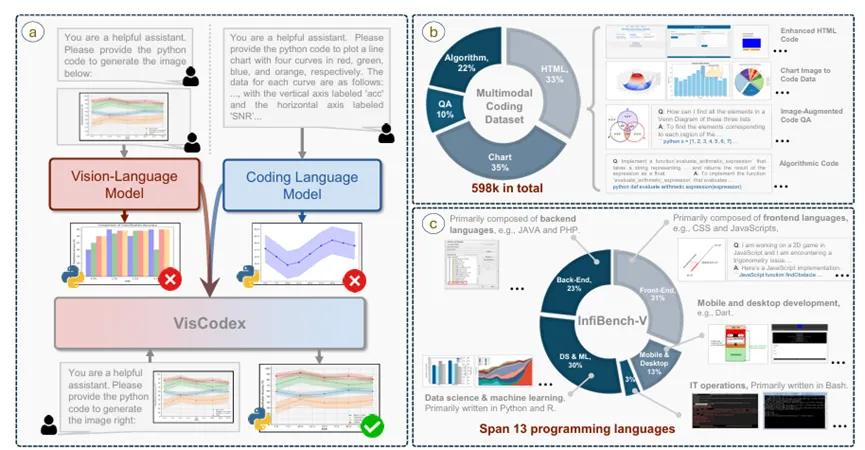

9.VisCodex:通过融合视觉与编码模型,实现统一的多模态代码生成

论文链接:https://openreview.net/forum?id=hUXzPauNEM (opens in new tab)

多模态大语言模型虽然在视觉与文本理解方面取得显著进展,但根据视觉输入生成可执行代码的能力仍明显不足,现有模型往往缺乏将UI布局、数据图表等视觉元素转化为语法正确、功能完备代码的深层编程能力。

为此,研究员们提出了VisCodex统一框架,通过基于任务向量的模型融合技术,将先进的编码大语言模型无缝集成到视觉语言骨干网络中,在不破坏原有视觉感知能力的前提下注入代码生成能力。同时,研究员们构建了包含59.8万样本的多模态编码数据集(MCD)用于训练,并设计了专注于真实世界视觉编程问题的基准测试InfiBench-V。

实验结果表明,VisCodex在开源多模态模型中达到SOTA性能,8B版本超越了所有同规模开源模型及GPT-4o-mini,33B版本更是接近GPT-4o水平,在Design2Code和ChartMimic等基准测试中均取得了极具竞争力的分数。

由此可见,模型融合策略相比直接替换骨干网络具有更好的跨模态对齐能力,且在低资源场景下展现出卓越的数据效率,有效解决了视觉感知与代码生成的融合难题。